从互联网的诞生到移动互联网的普及,人们获取信息的渠道和沟通的实效性有了本质上的跃升,而随着多媒体、计算机视觉、AI等技术的快速落地,人们看待世界的方式也有了更加多元和立体的视角。如今,元宇宙的到来让数字世界和虚拟世界的界限变得模糊,相互之间彼此交融。在NVIDIA Omniverse的平台之上,虚拟世界正在加速使互联网从2D演变为充满活力的3D世界。“Omniverse能够创造一个真正的虚拟世界,通过创新和科学探索成就全新的时代。”NVIDIA中国区高级技术市场经理施澄秋表示。

在秋季GTC大会期间,NVIDIA公布了多项围绕Omniverse和NVIDIA Studio的最新发布,演示了利用Omniverse创建模拟仓库、模拟工厂,以及把物理和生物系统、5G的边缘部署、机器人、自动驾驶车辆,甚至是数字孪生联结在一起的虚拟世界。根据NVIDIA的说法,全新的Omniverse平台是物理级准确的3D虚拟世界的“连接件”,拥有AR、VR和多GPU渲染等功能,并集成基础设施和工业孪生应用程序与Bentley Systems和Esri的软件。通过将图形计算、物理模拟和AI相互融合,工程师和设计师可以为建筑和产品构建物理级准确的数字孪生,或创建大规模的仿真环境,以便在现实世界中部署机器人或自动驾驶汽车之前对其进行训练。

作为GPU的发明者,NVIDIA可谓是全球视觉运算的领军者之一。近年来,该公司在加速计算、智能计算等新兴领域加大投入,例如把AI计算引入Omniverse、将其变成创建和连接虚拟和真实世界的模拟引擎就是颇具代表性的举措。自去年12月发布Omniverse公测版以来,已有70000多个创作者下载,还有700多家公司的专业人士使用。这些公司包括宝马集团、CannonDesign、Epigraph、Ericsson、建筑公司HKS和KPF、Lockheed Martin,以及Sony Pictures Animation。在公测版的Omniverse中,有14个基于Omniverse Connect和扩展的程序,超过15款ISV专业应用程序和应用软件支持USD。USD是NVIDIA与Pixar合作的一种用于通用场景描述的语言,可以把ISV的生产力软件统一为USD描述性语言来解释数字资产。

此次,Omniverse带来了一些新特性,包括Showroom、Farm,以及在VR、AR方面的更新。例如,Showroom允许非技术用户使用Omniverse技术演示,展示平台的实时物理和渲染技术。Farm在系统层可以对多GPU进行多节点渲染和模拟,在GTC上有超过6万帧的画面和多个演示中的视频、3D渲染、物理模拟、实时光线追踪等技术都是基于Omniverse Farm所实现,并且可以进行规模堆叠和拓展,具有很好的资源弹性。Omniverse AR能够用图形串流的方式把增强现实串流到设备上,仍在开发中的Omniverse VR则支持全帧率的实时光线追踪,可以做到实时的虚拟现实体验。

除此之外,NVIDIA还推出了针对大型企业用户的Omniverse Enterprise,可以帮助不同行业的专业人士获得增强传统可视化工作流程的新功能,改变复杂的3D设计工作流,让全球团队在一个共享虚拟空间实现跨软件实时协作。目前,BOXX Technologies、戴尔、惠普、联想和超微等公司均可提供NVIDIA Omniverse Enterprise的订阅服务。该平台经过优化和认证,可在NVIDIA RTX专业移动工作站和基于NVIDIA EGX平台的台式机和服务器等NVIDIA认证系统上运行。

创意和设计团队可以使用Omniverse Enterprise,通过实时编辑协作功能连接Autodesk 3ds Max、Maya和Revit、Epic Games的虚幻引擎,McNeel & Associates的Rhino、Grasshopper和Trimble SketchUp工作流程。“Omniverse已经成为跨行业的数字孪生基础平台。”施澄秋说。

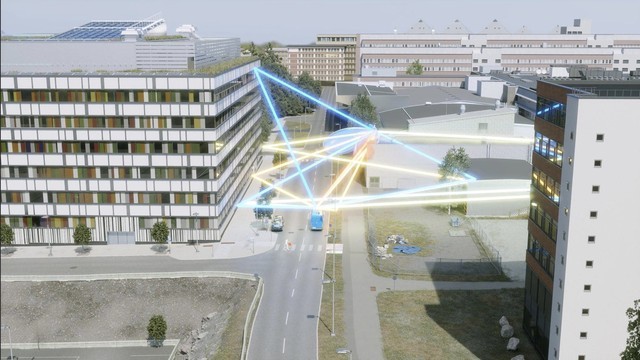

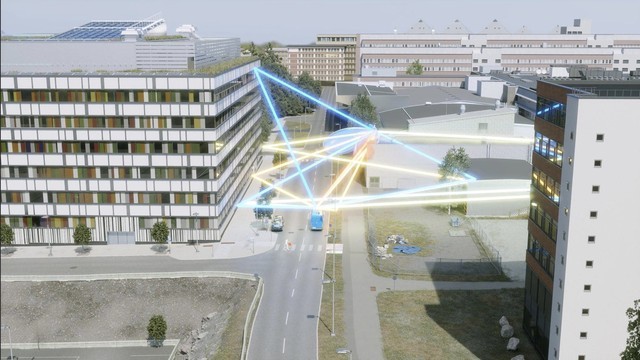

为了推行5G网络,未来5年全球要部署1500多万个微基站和塔站,如果没有数字孪生方法,对移动环境、人员和设备与无线发送端之间的交互的了解便缺少详细信息,网络建成后,很多功能必须进行现场测试。在 NVIDIA Omniverse 中,Ericsson正在构建城市规模的数字孪生,帮助准确模拟5G基站与环境之间的交互作用,从而更大程度地提高性能和覆盖率。

NVIDIA Omniverse可以生成丰富的物理参数匹配到数字孪生的城市中,能够实时模拟和像素化波束和5G信号。该平台提供关键技术,允许Ericsson跨动态环境元素准确模拟网络性能。NVIDIA RTX加速的实时光线追踪允许研究人员实时查看城市每个点的信号质量的精确表示,这在以前是不可能实现的,背后是成千上万次的光线与环境物体交互迭代后的路径追踪。利用RTX GPU光线追踪功能做路径渲染,进行不同颜色光线的调整等操作以确定信号强弱、数据吞吐量等信息,就可以让工程师相应调节基站位置,防止移动车辆的物体、虚拟大流量的移动车辆物体对信号造成影响。

Ericsson在Omniverse中的真实环境模拟

借助Omniverse VR,网络工程师很快就能佩戴虚拟现实头显设备,按照 1:1 的比例以虚拟方式探索任意模型的各个部分,调整参数、天线,真正做到身临其境,由此获得通用电信洞察力、更快的开发周期,以更低的成本实现更先进的网络。

Ericsson在Omniverse中打造城市规模数字孪生,模拟5G微基站和塔的正确放置,以实现最大的性能和覆盖范围

据估计,由于气候变暖和空气干燥,大规模森林火灾席卷全球,去年一年仅是在美国西部就造成近200亿美元的损失。截至目前,森林大火今年已经侵袭了美国650多万英亩的土地,而且问题还远不止于此。西伯利亚有更多的土地被烧焦,漫天的大火还席卷了地中海地区和澳大利亚。为此,NVIDIA和洛克希德·马丁与美国农业部林务局和科罗拉多州火灾预防与控制部门(DFPC)达成合作,将使用人工智能和数字孪生模拟,更好地了解森林火灾并阻止其蔓延。

NVIDIA和洛克希德·马丁还将共同创建全球首个专门预测和应对森林火灾的人工智能实验室。该实验室将使用NVIDIA人工智能基础设施以及NVIDIA Omniverse Enterprise高级可视化和虚拟世界仿真平台来确定火灾等级,并对其发展态势做出预测。该系统将在一个高度仿真的数字孪生体中再现火灾,为灭火提供最佳行动建议。该人工智能开发实验室将设在硅谷,并采用洛克希德·马丁公司的认知任务管理器(CMM)系统。作为基于端到端人工智能的规划与协调平台,该系统可以把火灾相关实时传感器数据与燃料植被、地形、风速等更多数据源相结合,以预测火灾蔓延的趋势。CMM可以向事故指挥小组提供行动建议,缩短响应时间,提高灭火和人道主义行动的成功率。

在消防行业,主要依靠衍生自Rothermel火灾蔓延模型的工具来预测火灾进展。洛克希德·马丁公司的团队正在与创建该模型的团队——林业局密苏拉火灾科学实验室合作,以检验人工智能如何从速度和准确性两方面改进现有的火情预测方法。洛克希德·马丁公司会提供应用人工智能、平台集成、规划和监督领域的专业知识,以及数十名应用工程师和数据科学家,并基于实时、多GPU可扩展模拟平台,创建了预测火灾动向的可视化图景,并对其在数字复制环境中的流体动力学进行研究。NVIDIA则负责提供数据分析和模拟相关专业知识,帮助实验室进行开发、建模、测试和部署。

CMM的人工智能模型利用红外摄像机捕捉到的卡梅隆峰大火的历史数据,在综合考虑海拔、坡度、地形和风力等因素后,预测了大火的走势。随后,工作人员将相关数据输入NVIDIA Omniverse可视化和仿真平台,并创建了上述火灾的数字副本。

借助NVIDIA Omniverse,洛克希德·马丁公司的团队不仅能展示Rothermel模型和CMM算法如何预测火灾,还可以使用真实数据再现过往火灾场景,加速新人工智能模型的训练、开发和评估。工程师也因此能够同步对比过往火灾发展情况与两个模型的预测结果。NVIDIA Omniverse还为应急响应人员、操作员和工程师提供了沉浸式的数字孪生环境,以评估其灭火行动的成效。

位于蒙大拿州的美国农业部林务局密苏拉火灾科学实验室在林野火灾研究领域处在前沿,并且一直在为火情分析和模拟提供相关应用程序、数据、软件和产品。该实验室使用Rothermel火灾蔓延模型开发出FARSITE森林火灾增长和行为预测工具。该实验室为洛克希德·马丁团队提供了重要的火灾走势和历史数据专业知识。

DFPC率先采用了两家公司正在研发的CMM AI技术,通过实时数据收集,提供专业知识、用户体验和反馈,并实现平台集成。洛克希德·马丁公司的团队与多任务飞机项目团队一起参与行动,并直接从多任务飞机的地图中收集科罗拉多州火灾的数据。科罗拉多州消防与控制部门还提供了历史火灾数据,用于NVIDIA Omniverse中的可视化建模。通过三方持续合作,洛克希德·马丁公司的工程师可以处理数据,并通过CMM对飞机实时观察到的森林火灾进行灾情预测,从而为现场的火灾应急人员提供帮助。

NVIDIA中国区传媒娱乐行业经理何展称:“Omniverse的核心组件就是强大的渲染引擎,如果想尝试在真实的世界和数字虚拟世界中间有一个可交互的平台,Omniverse就能提供这样的可能。未来一定会出现数字虚拟世界,其底层核心离不开我们提供的算力、计算引擎等技术。”

在GTC上,NVIDIA公布了基于Omniverse Enterprise为数字孪生开发的物理AI开发框架NVIDIA Modulus。NVIDIA Modulus可以使用物理加速的机器学习进行深度神经网络模型训练,把自然界的一些物理规律分装到数字孪生中,使得虚拟模型拥有与真实世界相媲美的体验。之后,NVIDIA Modulus会输出替代模型应用在各种各样的程序上。基于数字孪生平台将数据做模拟和分析,再用物理加速和模拟环境做迭代来探索设计上遇到的问题,可以避免在真实世界的训练成本,另外由于训练可能会面临法理和安全方面的风险,还能通过虚拟平台内的数字分身让用户自定义选择不同的策略。在Omniverse Enterprise中,NVIDIA Modulus支持多节点多范围的训练,可以达到数千倍至十万倍的能力提升,专门为数字分身训练和深度神经网络进行了优化。

Omniverse Replicator是用于3D工作流程的虚拟世界模拟和协作平台NVIDIA Omniverse的一部分,能够生成用于训练深度神经网络的物理模拟合成数据。NVIDIA发布了两个用于生成合成数据的应用,分别是用于承载自动驾驶汽车数字孪生的虚拟世界——NVIDIA DRIVE Sim,以及用于可操纵机器人数字孪生的虚拟世界——NVIDIA Isaac Sim。DRIVE Sim可用于无人驾驶车、自驾车、大型自主移动车辆,Isaac Sim可用于自主驾驶车辆、机器人的训练。Omniverse Replicator平台就像是复制器,可以把在NVIDIA Modulus中建模做成的相应模组进行复制,变成合成数据的生成引擎,为深度神经网络训练提供合成数据,应用复制器可以让开发者搭建自己的AI模型,来填补真实世界中间事物的空缺,完成超前的训练和部署,得出人类无法获知的实践结论。

首批基于Omniverse Replicator的应用DRIVE Sim和Isaac Sim,加速了自动驾驶汽车和机器人的开发

在无人驾驶车辆路测中,运用NVIDIA Omniverse Replicator中的DRIVE Sim可以完成路径追踪等操作,还原真实世界中的实际效果。在模拟各种各样的LED屏闪、动态模糊,以及其他车辆的激光雷达、多普勒效应、弥漫效应等对无人驾驶车辆衍生出来的边际效应时,可以利用DRIVE Hyperion 8的自动驾驶工具包,与Omniverse Replicatorer协同进行自驾车的训练。通过DRIVE Sim的复制器生成数百万张图片,与模拟数据进行不亚于真实路训的模型。在训练好的模型做好之后,可直接通过DNN方式部署到各式各样的模型上,大幅节省研发时间。

值得一提的是,NVIDIA还展示了用于生成交互式AI虚拟形象的技术平台——NVIDIA Omniverse Avatar。Omniverse Avatar能够连接NVIDIA在语音AI、计算机视觉、自然语言理解、推荐引擎和模拟方面的技术,在该平台上创建的虚拟形象是具有光线追踪3D图像效果的交互式角色,可以看到、说话、谈论各种主题,以及合理地理解表达意图。基于Omniverse Avatar开发的AI助手可以根据各个行业的需求进行定制,例如用于客户支持的Project Tokkio、用于永久在线车载智能服务的NVIDIA DRIVE Concierge,以及用于视频会议的Project Maxine等。

在Project Tokkio演示中,出现了餐厅自助服务亭中的一个客户服务虚拟形象。演示中,有两名顾客正在订购素食汉堡、薯条和饮料,该虚拟形象看到了他们、与他们交谈并理解了他们。在DRIVE Concierge AI平台演示中,中央仪表盘屏幕上的数字助理帮助驾驶者选择了最佳驾驶模式以准时到达目的地,然后按照驾驶者的要求,设置在汽车续航里程下降到100英里以下时进行提醒。NVIDIA还展示了Project Maxine如何为虚拟协作和内容创作应用增加先进的视频和音频功能——一个讲英语的人在嘈杂的咖啡馆里进行视频通话,但是其他人可以清楚地听到她所说的话,没有背景噪音。当她讲话时,她的话被实时转录并翻译成德语、法语和西班牙语,并且声音和语调与原话完全相同。

Omniverse Avatar具备的语音AI、计算机视觉、自然语言理解、推荐引擎、面部动画和图像元素等技术由一系列工具支持:语音识别基于NVIDIA Riva,这个软件开发工具包可以识别多种语言的语音,还可通过文本语音转换功能生成接近真人的语音反馈;自然语言理解基于Megatron 530B大型语言模型,该模型可以识别、理解和生成人类语言,这一个预训练模型能在很少或没有训练的情况下完成句子、回答主题广泛的问题、总结长而复杂的故事、翻译成其他语言,并应对许多它未接受过专门训练的情景;推荐引擎由NVIDIA Merlin提供;该框架使企业可以建立能够处理大量数据的深度学习推荐系统,以提出更明智的建议;感知功能来自用于视频分析的计算机视觉框架NVIDIA Metropolis;虚拟形象动画由AI赋能的2D和3D面部动画和渲染技术NVIDIA Video2Face和Audio2Face驱动。这些技术被集成在一个应用,使用NVIDIA统一计算框架进行实时处理,在被打包成可扩展、自定义微服务后,能够通过NVIDIA Fleet Command在多个地点安全地部署、管理和协调。

在Omniverse平台之上,承载了横跨企业级和消费级的NVIDIA Studio,快速增长的多媒体受众可以在NVIDIA Studio认证设备上制作原创的数字内容,有超过3000万的实时流媒体UP主可能会用到NVIDIA Studio和Omniverse加速后期创意工作流程,以制作更好的特效,实现更逼真、更有亲和力的画面效果和数字内容,还有8500万的学生群体在学习媒体、工程、数学、技术、理工等课程时,需要配备强大GPU的PC。这些都是NVIDIA面前的商业机遇。

NVIDIA Studio以新一代RTX GPU为核心,具备实时渲染、光线追踪、AI加速等能力,配合专门优化过的驱动程序为创意工作者提供了高性能且高可靠的体验。Studio的SDK中汇聚了丰富的组件和功能,NVIDIA的合作伙伴可以借此优化在应用程序在Omniverse、NVIDIA GPU上的性能表现。如同Game Ready驱动,Studio驱动程序也会在专业工具更新时同步上线一个准备就绪的新版本,来确保用户可以无缝使用。Studio软件开发工具包叠加于NVIDIA的底层应用和驱动之上,内置了CUDA、视频AI引擎等工具和技术,可以支持超过200款的创意应用。

NVIDIA Canvas可以利用对抗性生成网络色生成自主的基于AI的创意的迭代加速平台,可以让专业的艺术创作者更快、更好地完成AI 2D图形创作,支持15种画笔和19种AI样式,也可以把文件导入到Photoshop中。在演示中,艺术人员在绘画板上绘画时,AI可以根据绘画内容涂层自由生成实时画面场景,这些实时的画面场景可以变成一个Photoshop+人工智能的组合,最后生成文件。

借助NVIDIA Studio SDK和NVIDIA Broadcast,用户可以做出各式各样的应用,例如编辑视频时可以取超分辨率的大画面,AI可以自动根据声音的来源将视频中的人剪裁在画面中央位置,因为取样的分辨率场景足够大,就可以实时保持画面居中。同时,还可以进行AI降噪、虚拟绿幕、画面增强、画面过滤,例如开视频会议时过滤杂乱的背景、去掉嘈杂的背景声等。目前,Facebook、LackRoom,RSoft、达芬奇、斗鱼等厂商都在使用NVIDIA的Studio SDK、NVIDIA Omniverse、RTX GPU的强劲算力、主流3D渲染器等能力进行开发。

得益于RTX GPU的支持,Adobe Photoshop超分功能缩放图像可以比CPU处理快25倍,几乎是无延时且平滑的。基于生成式对抗网络,可以获得更自然的Photoshop滤镜,允许创作者使用拖动条即可编辑人物发型、表情、年龄等元素,并支持实时渲染。借助DLSS(Deep Learning Super Sampling)功能,可以在D5渲染器内调用NVIDIA RTX GPU的Tensor Core进行基于深度学习的超级采样,对体验进行多种优化,包括将帧率提升超过两倍,从19fps提升到35fps,并且支持实时的光线追踪等。已经有超过18款不同的创意应用程序、创意工作室采用了DLSS,利用AI在同样帧率下获得更高的分辨率,或是在同样分辨率下获得更高的帧数。

施澄秋介绍称:“已经有很多不同的应用程序在使用DLSS,比如UE,很多游戏是用UE来开发的,可以在其中创建3D建模、3D场景,3D过场动画等元素。此外,很多传统的平面式画面、VR/AR也是用UE开发的。UE原生支持DLSS,也就是说用UE开发出来的许多的程序自然就可以支持DLSS。”

截至目前,已经有超过70款被NVIDIA Studio SDK加速的垂直创意应用程序,为个人或企业管理更庞大的数字资产。用户能够利用Omniverse平台和USD通用场景描述进行各种ISV应用之间的数字资产的统一调度,构建免导入导出、在线实时分布式的协作平台。使用Blender、UE等的6K、8K的在线创作者,能够使用RTX GPU、Studio驱动、Omniverse Enterprise平台进行综合创作应用流的加速,满足各类应用流程的需求。这些应用程序使用NVIDIA Studio SDK进行开发,可以利用NVIDIA GPU和驱动程序进行加速。

可以说,始于图形计算的NVIDIA正在将运算能力向更广阔的未来进行延伸,遍及元宇宙世界的各个场景。“NVIDIA对元宇宙的理解是非常纯粹的,就是元宇宙始终需要算力来推动,软件、硬件等融合成一个平台,这个平台提供元宇宙的支撑、设计、实施、建模、模拟、测试、训练、部署,也就是NVIDIA的Omniverse平台。“ 施澄秋谈到,“我们所有对元宇宙的猜想和构建都搭建在Omniverse平台上,我们希望Omniverse能承载元宇宙。过去十年里,NVIDIA GPU算力呈现爆炸式增长,迭代速度远超摩尔定律的预期。未来,元宇宙真正的爆发点将是软硬件、平台、解决方案堆栈的融合。”

本文属于原创文章,如若转载,请注明来源:NVIDIA的下一跳:在数字世界计算未来https://cloud.zol.com.cn/781/7817728.html

![影驰(Galaxy)GeForce RTX3070?GAMER?OC[FG] N卡/电竞专业游戏显卡](https://doc-fd.zol-img.com.cn/t_s640x2000/g6/M00/0F/0F/ChMkKmGgtyuIG5hHAAALgrT_AfkAAWAcAJ-6agAAAua856.jpg)